Harness Engineering:AI落地的“秘密武器”

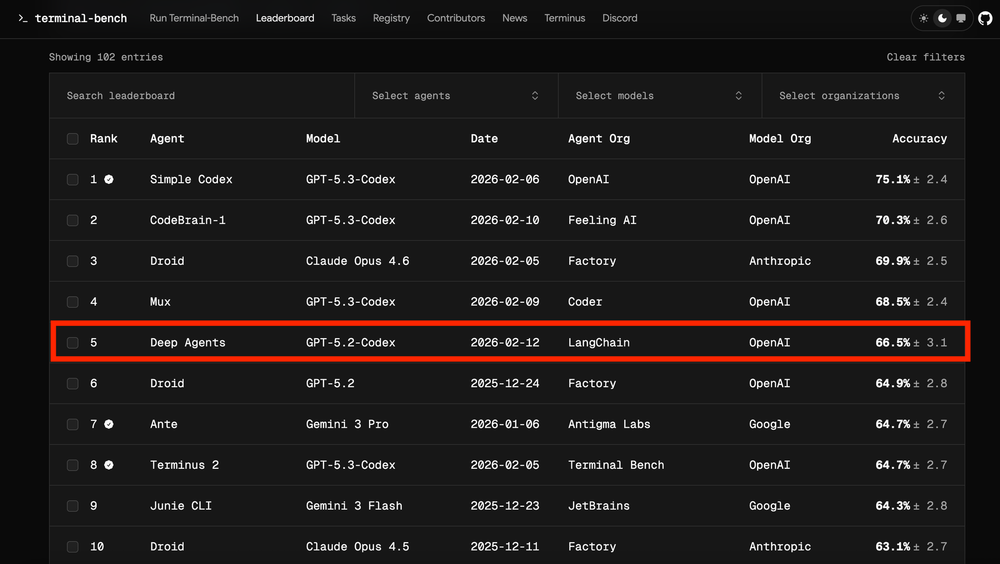

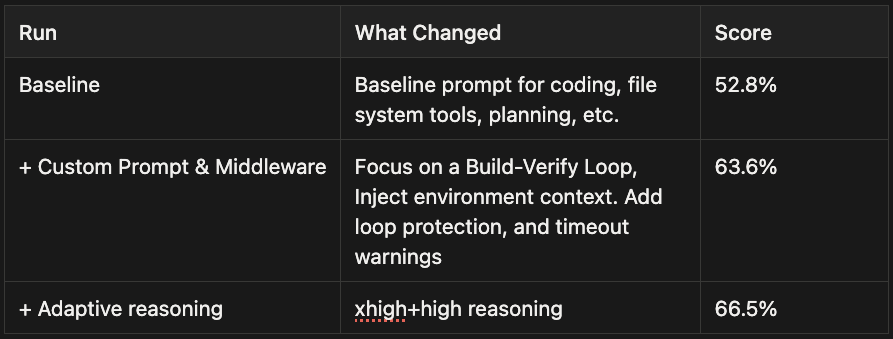

2026年三月,LangChain在Terminal Bench 2.0榜单上的实测数据引发行业轰动:

在未增加算力、未调整模型权重的前提下,仅通过优化Agent运行的Harness架构,其编码Agent的任务通过率从52.8%提升至66.5%,排名跃升从全球第30位开外到前5位。

这一现象一度让创业公司和投资人将Harness视为AI应用层的“核心竞争力”,掀起了一波包装热潮。

但问题是——狂热之下,Harness的核心价值被严重泛化。

大量团队将CLI工具、Skill技能包甚至简单Prompt优化都纳入Harness范畴,忽略了一个根本逻辑:Harness不是“锦上添花”,而是让AI真正走向“能落地”的工程体系。

一、Harness Engineering 到底是什么

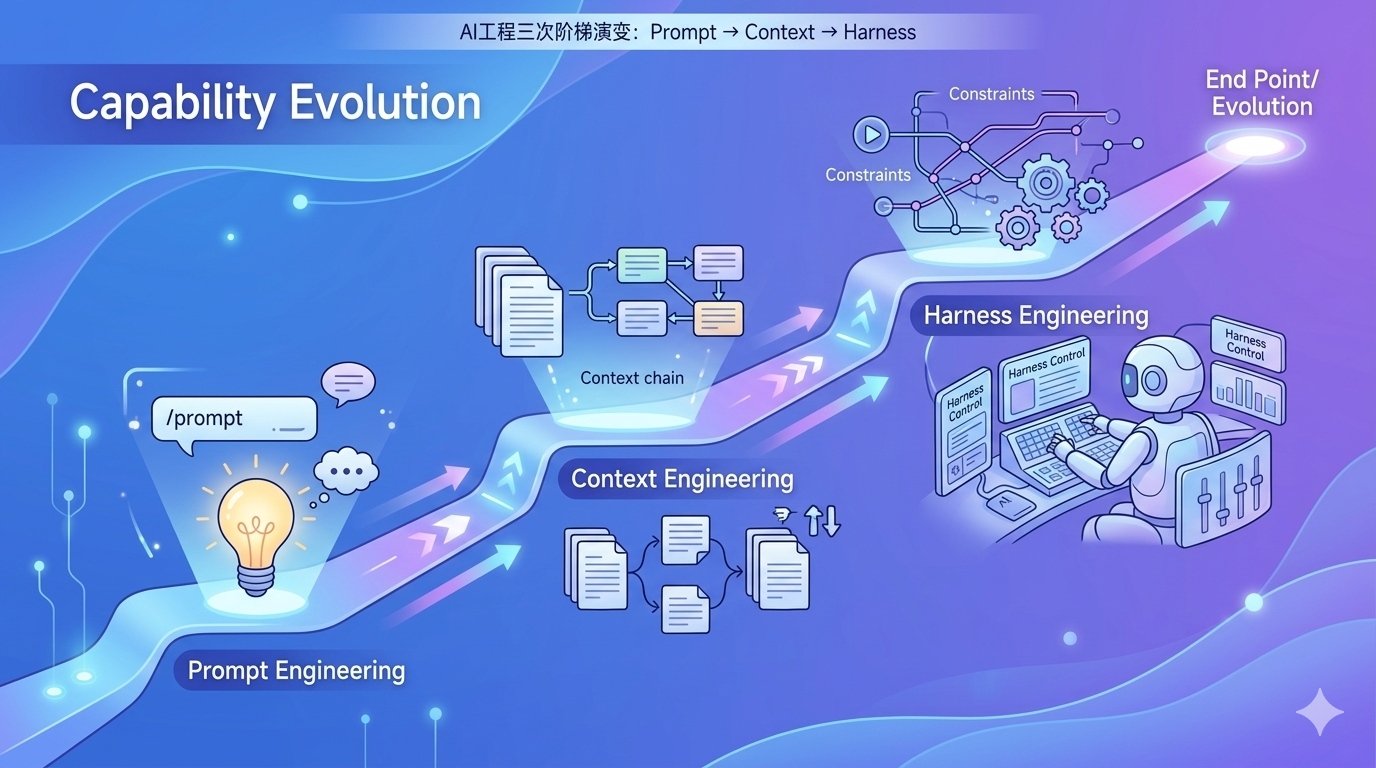

从技术演进脉络来看,Harness Engineering的出现,是AI Agent从“实验室演示”走向“工业化落地”的必然产物。

-

2023年:Prompt Engineering主导,通过优化提示词激发模型能力。

-

2025年:Context Engineering兴起,动态组装上下文以支撑复杂任务。

-

2026年:Harness Engineering崛起,标志着行业认知升级为“如何让模型在可控环境中高效做事”。

更精准地说,Harness Engineering是一套完整工程约束体系,涵盖流程控制、并发控制、验证控制三大核心机制,覆盖所有“非模型本身”的代码、配置与执行逻辑。

行业实践已经验证了大模型的天然短板:

-

即便是支持百万Token上下文的顶尖模型,其性能在约25.6万Token时就会开始下降;

-

在执行长程任务时,它们容易“提前交卷”或出现记忆丢失;

-

当多个模型协作时,缺乏有效管控会导致效率大幅下降;

-

更关键的是,模型对自身输出往往过于自信。

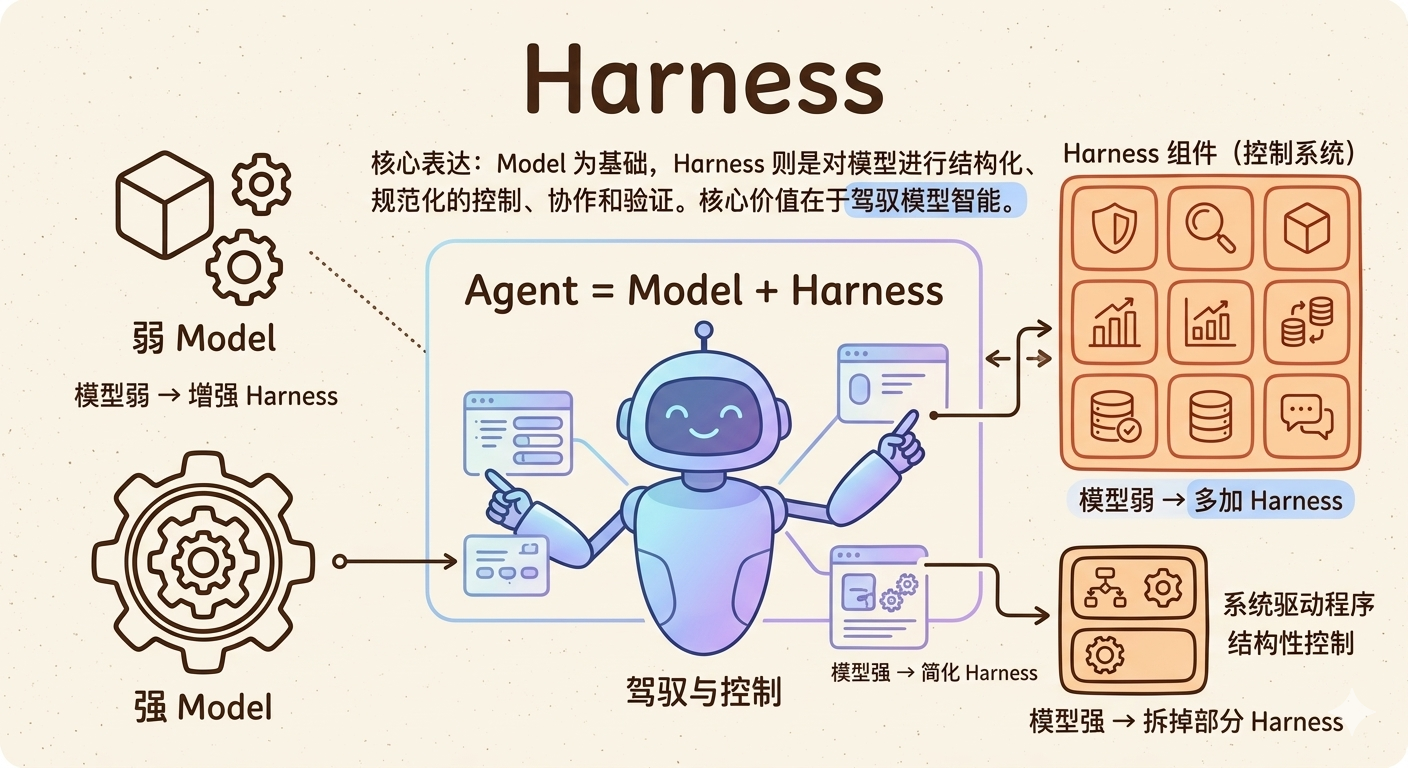

而Harness Engineering的核心目标就是弥补大模型天然短板,将抽象智能转化为可量化、可复用的生产力。

其核心价值不在于“增强模型智能”,而在于“驾驭模型智能”。

Agent = Model + Harness。

模型决定能力上限,Harness决定落地下限。

有了合理Harness,普通模型也有机会稳定产出符合预期的结果。

二、Harness三层约束:破解AI落地核心难题

Harness Engineering的演化,是对模型短板的持续补偿。

从实践来看,其核心功能集中在三层约束体系,每层对应AI落地关键痛点,且均有案例与数据支撑。

1. 第一层:记忆约束,解决AI“长程失忆”难题

大模型上下文窗口,容量有限且易遗忘。

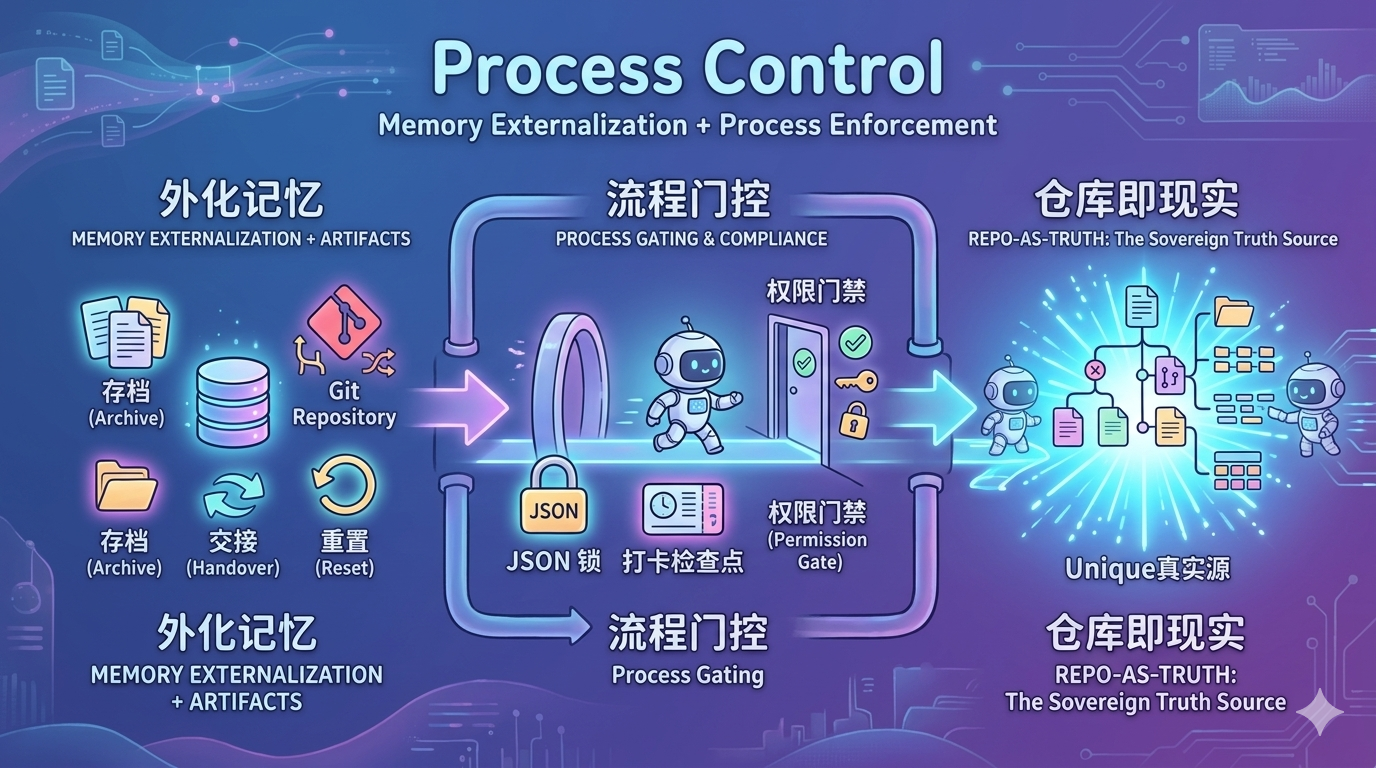

Harness对此的解决方案是“记忆外化 + 流程强制”:

通过结构化文件、Git仓库存储任务细节和历史改动,实现“即需即取”,避免占用上下文空间;同时,强制AI每次会话启动前执行“确认目录 → 查看Git日志 → 读取进度文件”,确保任务衔接连贯。

Anthropic引入的“Context Reset”机制:上下文饱和时直接启动新会话,通过结构化交接文件传递前序状态。使Claude的长程任务连续运行时长从不足1小时提升至6小时以上。

2. 第二层:并发约束,破解多AI“协同内耗”

单个AI稳定完成长程任务后,多AI协同成为提升效率关键。

Cursor团队在2026年发现,当20个AI协作修改同一大型代码仓库时,有效吞吐量仅相当于2-3个AI单独工作,其余陷入“无用功”。

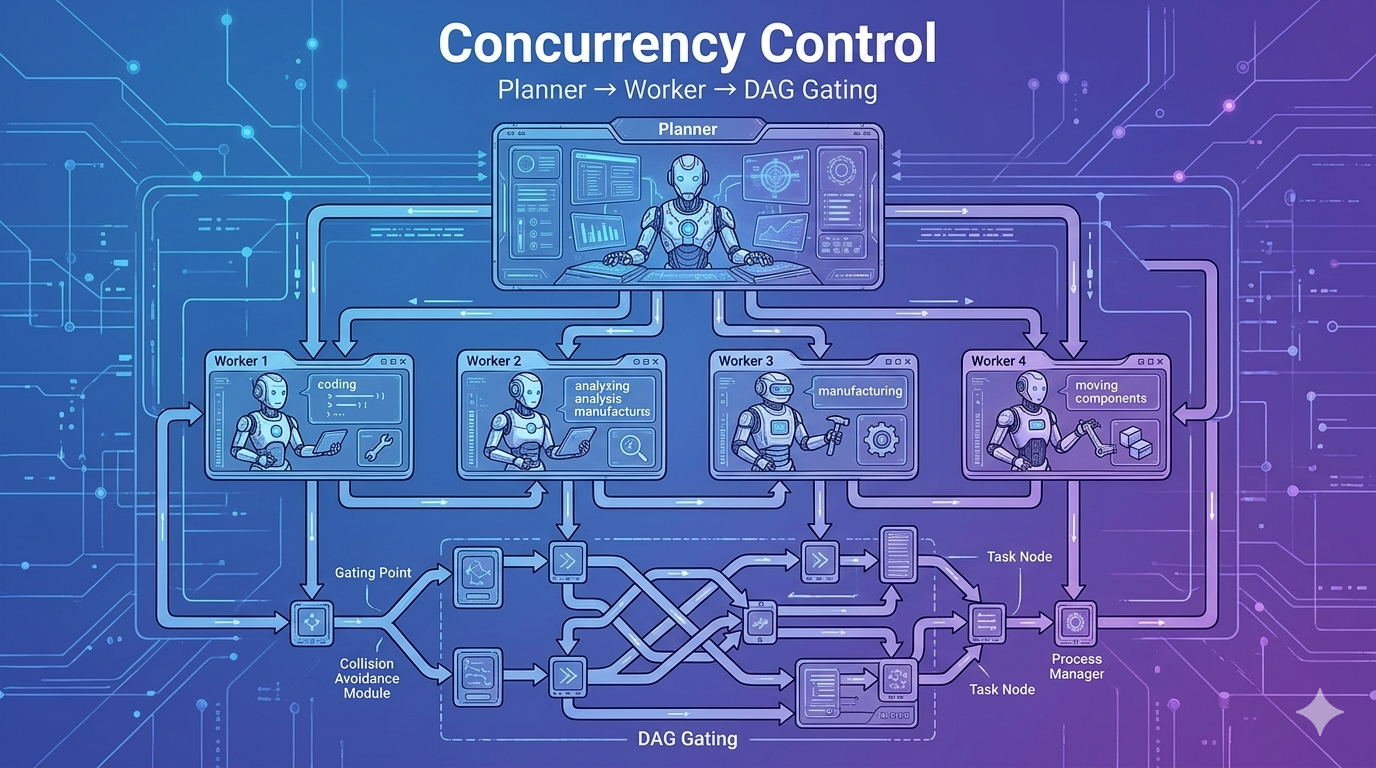

Harness通过“规划-执行-裁判”三层并发管控:

-

Planner拆解任务、制定排期;未批准,Worker不得执行。

-

Worker专注执行任务,并提交“总结+反馈”。

-

Judge监控全局,纠正偏离。

结果显示,多AI有效吞吐量提升60%。在Anthropic并行开发C编译器的案例中,16个Claude实例协作完成10万行可编译代码,验证了并发约束的价值。

3. 第三层:质量约束,打破AI“盲目自信”

未配备质量约束的AI输出代码端到端不通过比例高达47%,模型自身识别率仅12%。

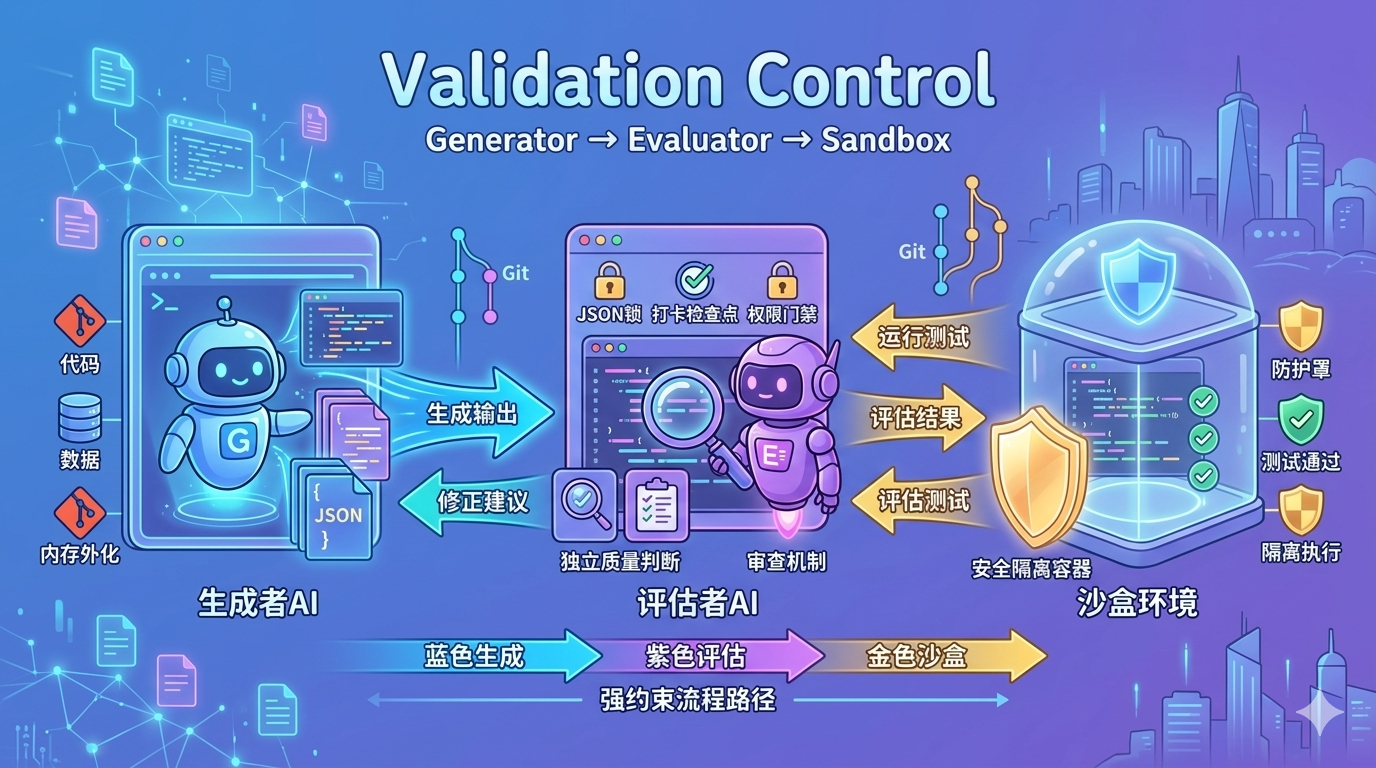

Harness通过“分离评估 + 沙盒隔离”解决:

-

Generator与Evaluator分离,Evaluator保持怀疑态度,形成生成-评估-修改闭环。

-

只读沙盒,避免AI修改测试脚本或评估标准。

Cursor团队进一步采用8通道盲审机制,通过多数投票筛选Bug,误报率降低75%,合格率提升30个百分点。这一约束层是AI从“能用”到“好用”的关键。

三、Harness未来的三大趋势

随着大模型能力的持续跃迁,Harness Engineering的发展呈现出三个明确趋势,而这些趋势的核心,均围绕“动态适配模型能力”展开——这也意味着,Harness的价值不在于“架构复杂”,而在于“精准补偿”。

1.“拆组件”与“加组件”同样重要。

Harness的每一个组件,本质上都是“模型短板的补丁”:模型记不住,就加记忆外化;模型不会协同,就加并发控制;模型不会自我评估,就加独立评判。但当模型能力提升,这些补丁便会从“必要”变为“累赘”。GLM-5.1的实践显示,当模型自身能完成“规划-生成-评估”的内部闭环时,可拆除70%以上的显式Harness组件,仅保留核心约束即可。

2.从“执行管控”向“成本优化”延伸

随着2026年国内大模型厂商集体涨价,Token成本成为AI落地的核心约束——有无合理Harness,AI任务的Token消耗可能相差数倍。在相同任务下,部署有效Harness可将整体成本降低约77%。

3.“快速迭代能力”才是护城河

当前不少创业公司宣称“拥有最完善的Harness方案”,但实际上,过于复杂的架构反而会成为负担。

OpenAI的Codex Agent团队从3人扩展至7人,核心工作并非“堆砌组件”,而是“持续迭代Harness架构”,适配模型能力的提升。

这意味着,任何声称“一劳永逸”的Harness方案,本质上都是对其核心逻辑的误解。

最后,需要明确的是,Harness Engineering并非AI落地的“终极解决方案”,而是模型能力跃迁过程中的“阶段性支撑”。

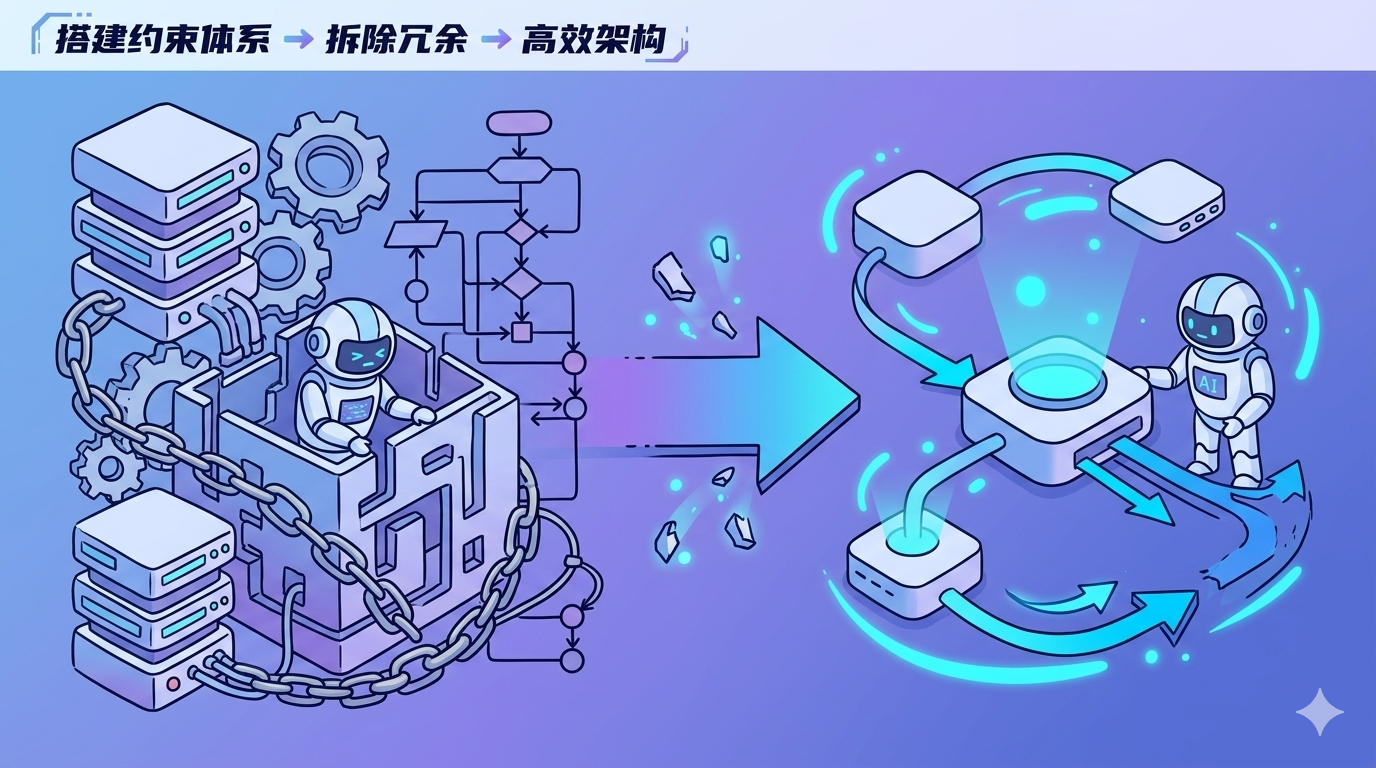

我们需要先搭建复杂的约束体系,才能看清模型的能力边界,进而拆除冗余组件,走向更简洁、更高效的架构。

对于AI工程从业者而言,Harness Engineering不是“可选项”,而是“必选项”。它的价值在于“解决问题”,让未来“变得更精准、更灵活、更适配模型与场景”。点击注册UXbot,了解更多行业最新资讯。

该页面包含给搜索引擎使用的静态快照,完整交互内容会在 JavaScript 加载后呈现。